Pe la jumătatea secolului trecut, după ce a contribuit în mod substanţial la inventarea computerelor, matematicianul englez Alan Turing a căutat să dezvolte o serie de teste prin care să demonstreze inteligenţa acestora.

Pe la jumătatea secolului trecut, după ce a contribuit în mod substanţial la inventarea computerelor, matematicianul englez Alan Turing a căutat să dezvolte o serie de teste prin care să demonstreze inteligenţa acestora.

Sistemele complexe - scurtă introducere (1)

Sisteme complexe - aparatul matematic (2)

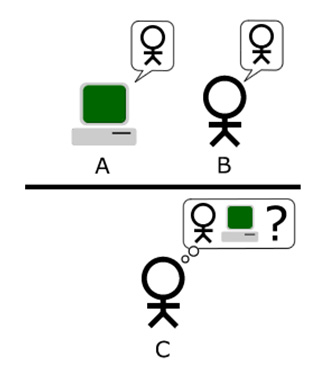

Un astfel de test apare în articolul Computing Machinery and Intelligence, publicat în anul 1950 în revista Mind şi este formulat astfel: un judecător uman se angajează într-o conversaţie cu un om şi cu un computer, ambii încercând să pară cât mai umani. Toţi participanţii sunt plasaţi în poziţii izolate, iar dacă judecătorul nu poate distinge între computer şi om, atunci putem spune că acel computer a trecut testul. Testul s-ar limita la o conversaţie prin text şi ar trebui să scoată în evidenţă capacitatea computerului de a da răspunsuri inteligibile şi originale la întrebările judecătorului. Prin acest test, Turing îşi propune să afle dacă se poate spune despre computere că pot gândi. Altfel spus, pot fi construite computere care să treacă testul Turing?

Interpretarea standard a testului Turing, în care subiectul C, cel care pune întrebări, are sarcina de a determina care dintre A şi B este om şi care maşină.

Aceste teste au constituit primele exigenţe pe care un artefact uman ar trebui să le îndeplinească pentru a fi considerat posesor de inteligenţă. Turing îşi continuă articolul argumentând împotriva scepticilor faţă de inteligenţa artificială, însă nici până azi, după 60 de ani, nu au fost construite astfel de computere.

Unul dintre motivele pentru care inteligenţa artificială este atât de dificil de obţinut ne este sugerat de către John Searle prin experimentul teoretic numit „camera chinezească”. Searle ne propune să ne imaginăm că ar fi fost inventat un computer inteligent care se comportă ca şi cum ar înţelege limba chineză. Adică primeşte un set de caractere chinezeşti ca input şi, prin prelucrarea acestora potrivit instrucţiunilor din program, produce ca output un alt set de caractere chinezeşti. Să presupunem că face acest lucru atât de bine încât trece cu uşurinţă testul Turing. După aceea, Searle ne roagă să ne imaginăm că suntem la un birou, într-o cameră închisă şi că avem asupra noastră o carte în limba engleză cu acest program de calculator (toate instrucţiunile necesare). Astfel, primind pe sub uşă o foaie cu un set de caractere chinezeşti şi „rulând” manual setul de instrucţiuni din carte, am fi capabili să producem un alt set de caractere chinezeşti ca output. Cum computerul a trecut testul, ar fi corect să presupunem că şi operatorul uman îl va trece cu aceeaşi uşurinţă.

Searle argumentează că nu există nici o diferenţă esenţială între cazul computerului şi cel al operatorului uman, întrucât în ambele situaţii se simulează un comportament inteligent urmându-se instrucţiunile pas-cu-pas. Totuşi, operatorul uman poate face asta fără a înţelege vreun simbol chinezesc. Astfel, nu putem afirma nici despre computer că trecerea testului dovedeşte faptul că acesta ar avea o înţelegere a limbii chineze şi că, în consecinţă, ar putea gândi. Searle subliniază că testul Turing se dovedeşte a fi insuficient şi că ceea ce ar trebui să realizeze inteligenta artificială nu este simularea comportamentului uman, ci intenţionalitatea comportamentală, singura care ne poate garanta prezenţa gândirii.

John Searle (n.1932)

(Mai mult pe Wikipedia(ro))

Însă felul în care ajung fiinţele umane să posede intenţionalitate nu este o problemă ce îi preocupă doar pe teoreticienii ştiinţei computerelor, ci şi pe biologi. Evoluţia darwiniană este binecunoscutul proces prin care organismele reproductive îşi combină moştenirea genetică pentru a da naştere unor urmaşi diferiţi, cu o moştenire genetică nouă. Acest proces simplu este responsabil pentru întreaga diversitate biologică, inclusiv pentru inteligenţa şi intenţionalitatea umană. Însă felul în care, în miliarde de ani de evoluţie, s-a ajuns de la molecule chimice la organisme biologice complicate rămâne încă principală problemă cu care se confruntă biologii.

Soluţia pe care o propune teoria sistemelor complexe la această problemă constă în concentrarea atenţiei asupra interacţiunilor neliniare de la nivel chimic şi biologic. Astfel, evoluţia ar fi un proces nedeterminist şi ireversibil, care s-ar realiza atunci când activitatea părţilor unui organism ar produce diverse regularităţi în comportamentul întregului, regularităţi care, cel puţin teoretic, nu pot fi deduse în mod analitic din cunoaşterea interacţiunilor părţilor. Altfel spus, comportamentul celulelor produce comportamentul organismului, însă cunoaşterea celui dintâi nu ne oferă cunoaşterea şi înţelegerea celui din urmă şi invers, cunoaşterea celui din urmă (a activităţilor inteligenţe) nu ne oferă posibilitatea înţelegerii celui dintâi. Potrivit teoriei sistemelor complexe, cele două planuri trebuie studiate separat, ca şi cum ar fi la două nivele de complexitate diferite şi ireductibile, pe cale teoretică, unul la celălalt.

În acest caz, realizarea inteligenţei artificiale ar presupune nu doar simularea inteligenţei umane ci, într-un fel, şi simularea evoluţiei organismului viu. De altfel, noile încercări de a realiza roboţi inteligenţi îi consideră pe aceştia ca sisteme complexe adaptive, capabile să interacţioneze cu mediul şi să-şi adapteze comportamentul. Unul dintre cele mai studiate comportamente complexe este reprezentat de fenomenul economic, iar în tabelul de mai jos David Colander ne propune să observăm diferenţele dintre perspectiva teoriei clasice asupra comportamentelor economice şi perspectiva teoriei complexităţilor. Primele 5 distincţii aparţin lui Eric Beinhocker, iar ultimele 4 îi aparţin lui Brian Arthur:

BIBLIOGRAFIE

Richard Loosemore, Complex Systems, Artificial Inteligence and Theoretical Psychology

Christoph Adami, Charles Ofria si Travis C. Collier, Evolution of Biological Complexity

http://en.wikipedia.org/wiki/Complex_adaptive_system

http://en.wikipedia.org/wiki/Turing_test

http://en.wikipedia.org/wiki/Chinese_room

http://en.wikipedia.org/wiki/Evolution_of_complexity

http://en.wikipedia.org/wiki/Complexity_economics