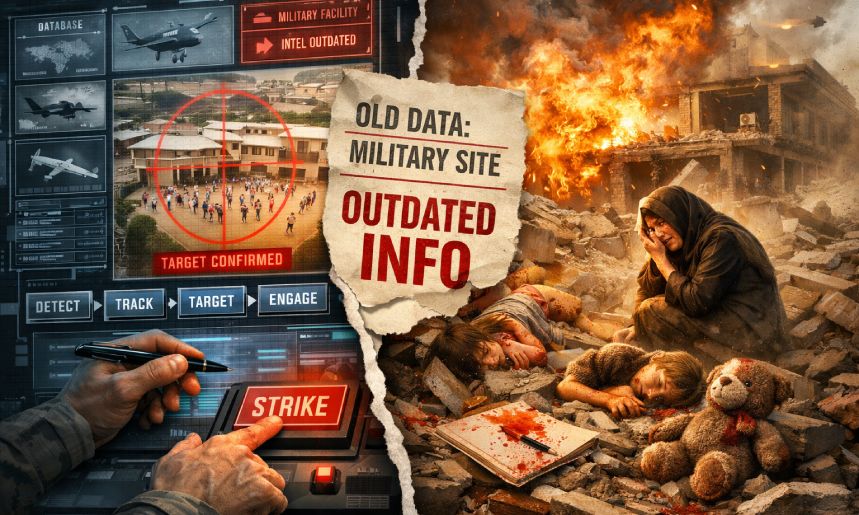

Pe 28 februarie 2026, în prima zi a operațiunii „Epic Fury”, forțele americane au lovit de mai multe ori o școală primară din Minab, în sudul Iranului. Între 175 și 180 de persoane au fost ucise, majoritatea fete cu vârste între 7 și 12 ani. În zilele care au urmat, atenția publică nu s-a concentrat pe lanțul decizional militar sau pe erorile instituționale, ci pe o întrebare spectaculoasă: a fost inteligența artificială responsabilă?

Numele vehiculat a fost Claude, un model conversațional dezvoltat de Anthropic. Presa și politicienii au speculat dacă un chatbot ar fi putut selecta ținta sau dacă ar putea deveni periculos în context militar. În realitate, această ipoteză nu ara legătură cu modul în care a fost ales obiectivul.

Sistemul real: Project Maven

Stabilirea țintei nu a fost realizată de un model lingvistic, ci de un sistem militar numit Project Maven. Inițiat de Departamentul Apărării și dezvoltat ulterior de Palantir Technologies, Maven este o infrastructură complexă care integrează imagini satelitare, date de la senzori și informații obținute de serviciile specializate.

Rolul său nu este de a „decide” în sens uman, ci de a accelera procesul: detectează, clasifică și transmite ținte de-a lungul unui flux decizional standardizat. Interfața seamănă cu un software de management de proiect, unde fiecare țintă trece prin etape până la aprobarea loviturii.

Modelul lingvistic Claude a fost adăugat abia ulterior, pentru sarcini periferice precum căutarea și rezumarea documentelor. El nu identifică ținte, nu procesează imagini radar și nu decide lovituri.

Eroarea critică: o bază de date neactualizată

Clădirea lovită fusese clasificată drept obiectiv militar într-o bază de date a serviciilor de informații. Însă informația era depășită: clădirea fusese separată de un complex militar și transformată în școală cu ani înainte, cel târziu în 2016.

Nu un algoritm a produs tragedia, ci un lanț de decizii și omisiuni umane: o bază de date neactualizată, validată de proceduri automate și integrată într-un sistem care accelerează execuția fără a încetini pentru verificări critice.

„Lanțul uciderii”: viteză în loc de judecată

În jargon militar, procesul se numește „kill chain” – lanțul dintre identificarea unei ținte și atacarea ei. De-a lungul deceniilor, acest lanț a fost optimizat constant pentru viteză.

În timpul Al Doilea Război Mondial, secvența era simplă: identificare, fixare, atac, evaluare. Ulterior, a devenit mult mai complexă. Scopul a rămas același: reducerea timpului dintre „a vedea” și „a lovi”.

Sistemul Maven reprezintă cea mai recentă etapă a acestei evoluții. În exerciții militare moderne, echipe foarte mici pot procesa volume de ținte care altădată necesitau mii de oameni. În unele scenarii, obiectivul este atingerea a 1.000 de decizii pe oră.

Această viteză are un cost: comprimă timpul necesar pentru îndoială, verificare și judecată.

Înainte de Maven, operatorii lucrau simultan cu opt sau nouă sisteme separate, extrăgând date din unul, verificându-le în altul și mutând manual detecțiile între platforme pentru a reuni informațiile și aprobările necesare fiecărei lovituri. Maven a reunit toate acestea într-o singură interfață.

Oamenii sunt cei care realizează țintirea. Sub interfață, sisteme de învățare automată analizează imagini satelitare și date de la senzori pentru a detecta și clasifica obiecte, atribuind fiecărei identificări un scor de încredere privind corectitudinea ei.

Trei clicuri transformă un punct de pe hartă într-o detecție formală și îl introduc într-un flux de stabilire a țintei. Aceste ținte se deplasează apoi prin coloane care reprezintă diferite procese decizionale și reguli de angajare.

Sistemul recomandă modul de lovire pentru fiecare țintă – ce aeronavă, dronă sau rachetă să fie folosită, ce armament să fie asociat – ceea ce armata numește un „curs de acțiune”. Ofițerul alege dintre opțiunile ierarhizate, iar sistemul, în funcție de utilizator, fie trimite pachetul de țintire spre aprobare, fie îl duce direct la execuție.

Inteligența artificială din spatele interfeței nu este un model lingvistic sau cel puțin partea relevantă nu este. Tehnologiile de bază sunt aceleași sisteme care îți recunosc pisica într-o bibliotecă foto sau care permit unei mașini autonome să combine camera, radarul și lidarul într-o imagine unitară a drumului, aplicate aici asupra imaginilor de dronă, radar și fotografiilor satelitare ale țintelor militare. Ele preced modelele lingvistice mari cu ani buni.

Nici Claude și nici alte modele de tip LLM nu detectează ținte, nu procesează radarul, nu combină datele de la senzori și nu asociază armele cu țintele. LLM-urile sunt adăugiri târzii în ecosistemul Palantir Technologies. La sfârșitul anului 2024, la ani după ce sistemul de bază era deja operațional, Palantir a adăugat un strat LLM – aici se încadrează Claude – care le permite analiștilor să caute și să rezume rapoarte de intelligence în limbaj obișnuit. Dar modelul lingvistic nu a fost niciodată esențial pentru acest sistem. Esențial a fost ceea ce Maven a făcut procesului de țintire: a unificat sistemele, a comprimat timpul și a redus numărul de oameni implicați. Aceasta nu este o idee nouă.

Fascinația tehnologică și distorsionarea atenției

Fenomenul prin care o tehnologie domină atenția publică a fost descris de cercetătoarea Morgan Ames în cartea The Charisma Machine. Ideea este că anumite tehnologii devin atât de importante în discurs, încât eclipsază factorii reali.

În acest caz, modelele lingvistice au devenit sinonime cu „inteligența artificială”, chiar dacă nu sunt implicate în procesele critice. Termeni precum „aliniere”, „halucinații” sau „siguranța IA” au structurat dezbaterea, dar nu au explicat tragedia.

Rezultatul este o deplasare a responsabilității: de la oameni și instituții către sisteme abstracte.

Lecția istorică: aceeași eroare, alte tehnologii

Situații similare au existat și înainte de era digitală. În timpul războiului din Vietnam, programul Operation Igloo White folosea senzori pentru a detecta mișcări pe trasee logistice. Sistemul era ușor de păcălit de, iar rezultatele raportate depășeau realitatea.

Problema nu era tehnologia în sine, ci faptul că sistemul ajunsese să-și valideze propriile rezultate. Nu mai exista o verificare externă reală.

Fricțiunea pierdută

Teoreticianul militar Carl von Clausewitz descria „fricțiunea” ca suma incertitudinilor și erorilor care apar în orice operațiune. Aceasta obligă la judecată și prudență.

Când procesele sunt accelerate excesiv, fricțiunea nu dispare, ci devine invizibilă. Sistemul continuă să funcționeze, dar fără conștientizarea limitelor sale.

În războiul modern, unde deciziile sunt mediate de ecrane, baze de date și modele, distanța dintre realitate și reprezentarea ei poate crește fără ca operatorii să o perceapă.

Problema nu este IA, ci modul în care o folosim

Bombardamentul din Minab nu a fost rezultatul unei inteligențe artificiale scăpate de sub control. A fost rezultatul unui sistem construit pentru viteză, alimentat de date imperfecte și operat într-un cadru care prioritizează eficiența în detrimentul reflecției.

Cineva a decis să comprime lanțul de lovire. Cineva a decis că deliberarea este o întârziere. Cineva a decis să construiască un sistem care produce 1.000 de decizii de țintire pe oră și să le numească de înaltă calitate. Cineva a decis să înceapă acest război.

Focalizarea obsesivă asupra chatbot-urilor ascunde problema reală: modul în care tehnologia este integrată în procese decizionale critice și modul în care responsabilitatea este distribuită – sau diluată – în interiorul acestor sisteme.

În final, nu algoritmii au ales ținta. Oamenii au construit un sistem în care o eroare veche a devenit instantaneu letală.

Sursa: TheGuardian